|

如何用AI手搓出一首MV 看效果: https://pan.baidu.com/s/1Xbyzv3gTAIjzL_J5BNm7vA 提取码:m316

你相信吗? 一首看起来像专业团队制作的MV,歌词有深情、旋律动听、画面唯美。 居然,是我一个人用AI做的。 关键是,我并没有作词基础、也不懂编曲。 这首AI MV已经在我的蝴蝶号发布,群友们也觉得太感动了。 人物一致性保持的还不错,场景也比较丰富,就是图片我没有做高清处理就去生成视频了,会有点模糊~ 这篇文章,我就手把手告诉你:我是怎么从0到1,用AI完成整部MV的。 一切从一句话开始:我做过很多AI短视频,但是并没有试过MV,然后就很想制作试下,说干就干~ 这首MV的灵感很简单: 看到很多群友们都在做MV,平常我也喜欢听歌,所以就想着创作一首英文的 脑海里一闪而过想到的就是凯莉·克莱森的《Because of You》 于是,我打开了AI助手Claude,因为克劳德的语库比较优美,创作比较好。与克劳德对话,仅仅十几秒,它给了我一首完整的英文歌词。

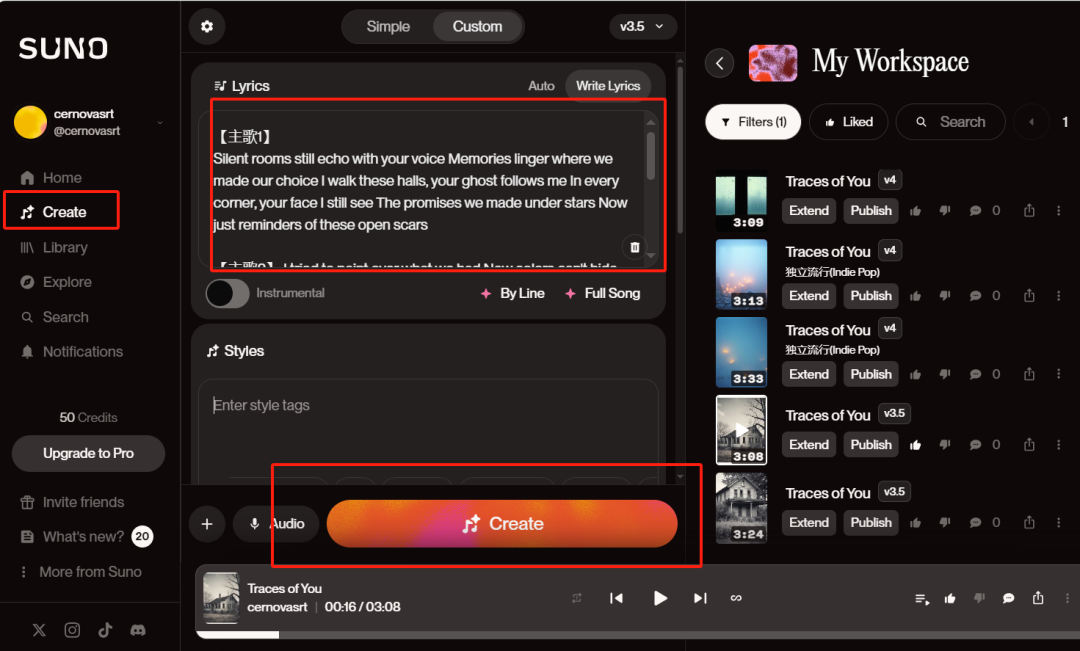

因为是英文的,翻译成中文看了下歌词的大致意思我就直接确定下来了 是不是很像某部欧美独立音乐短片的歌词? 旋律怎么来?我用Suno AI,一键生成原创音乐 有了歌词,下一步自然是配上旋律。 这里我用的是爆火AI音乐平台——【Suno AI】。 Suno网址:https://suno.com/ 登陆Suno,点击 Create

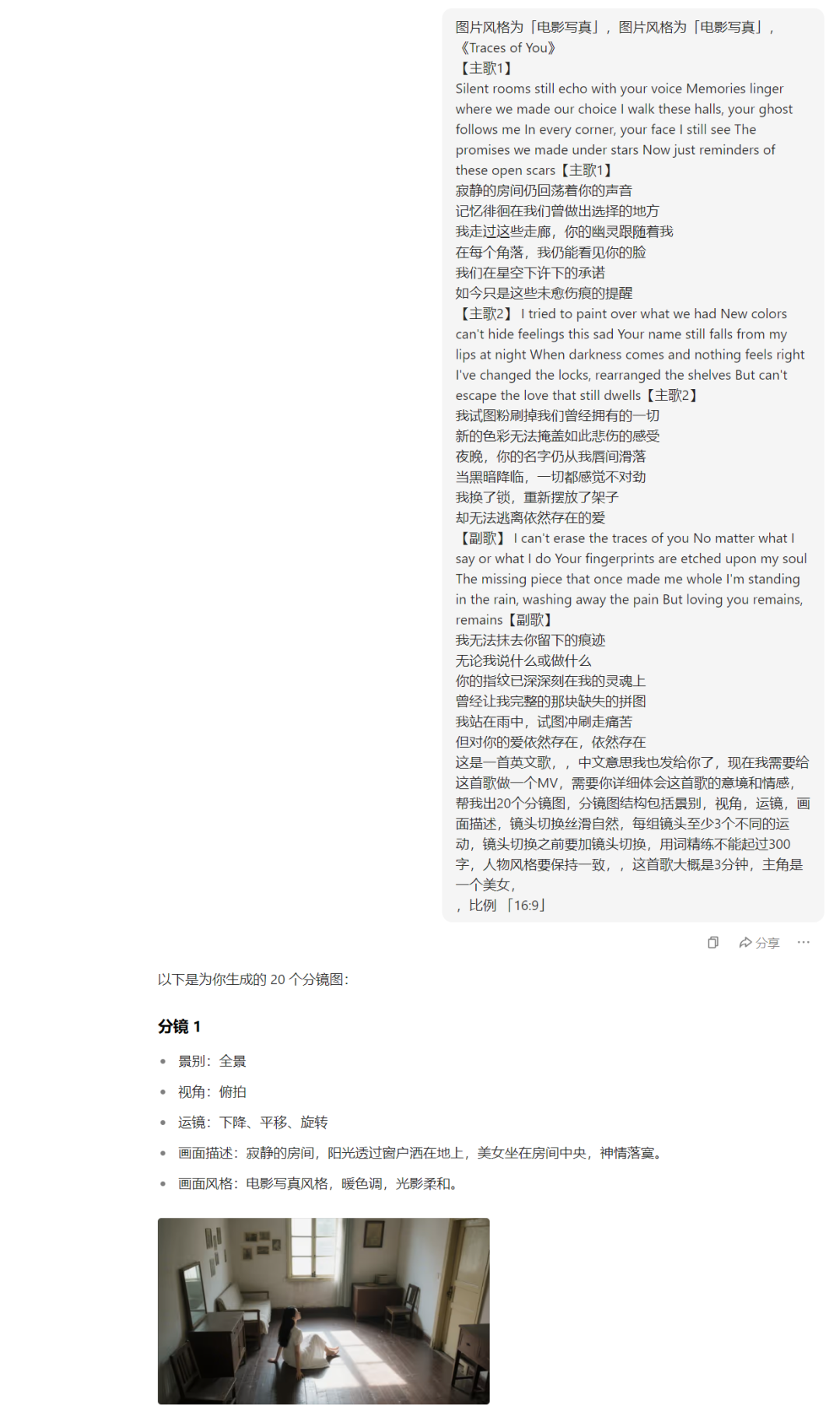

歌词我提前写好了,点击Custom直接把歌词粘贴上去,它就会自动谱曲、演唱、配器、混音,统统搞定! 我还用的是3.5模型,其实已经更新了4.5模型。 几分钟不到,一首完整的原创英文歌就出来了。 Suno的音色库是实时进化的,每次生成的歌都会不一样。建议多生成几次,选最动人的那一版。 分镜头脚本怎么办?我让豆包 + 即梦 + 可灵联合出马! 音乐有了,接下来看画面。 MV的节奏靠“镜头语言”撑起来, 这时候,我请出我的“画面策划团队”——豆包 直接让豆包生成分镜图

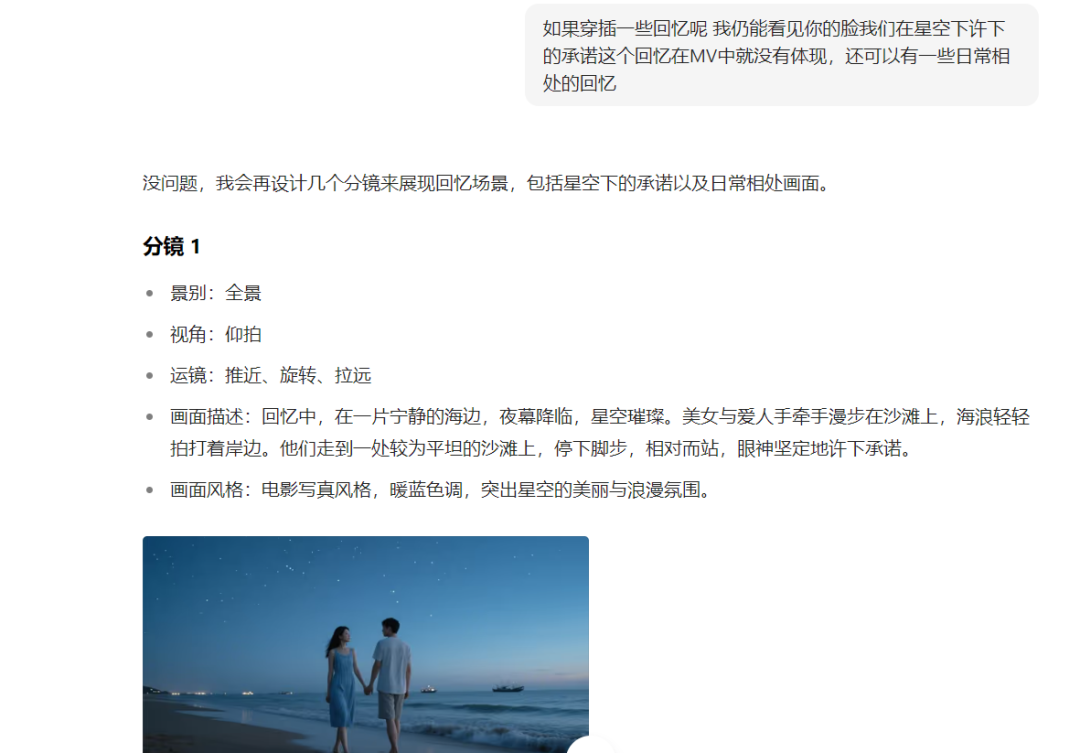

提示词如下: 这是一首英文歌,中文意思我也发给你了,现在我需要给这首歌做一个MV,需要你详细体会这首歌的意境和情感,帮我出20个分镜图,分镜图结构包括景别,视角,运镜,画面描述,镜头切换丝滑自然,每组镜头至少3个不同的运动,镜头切换之前要加镜头切换,用词精练不能起过300字,人物风格要保持一致,这首歌大概是3分钟,主角是一个美女 篇幅有限,歌词部分就不放这了,最重要的是这段提示词,歌词部分是让豆包理解这个MV的情感与意境。 当然豆包生成的分镜图也不是一次就过了,有些图片也是不怎么行,我们需要不断的与它对话,让它了解需求,这样出来的分镜图可能会更满足你的要求。 我做这个MV一开始是为了先走通这个流程,所以跟豆包知识简单对话几轮就决定了分镜图,但是没想到的是效果还挺好

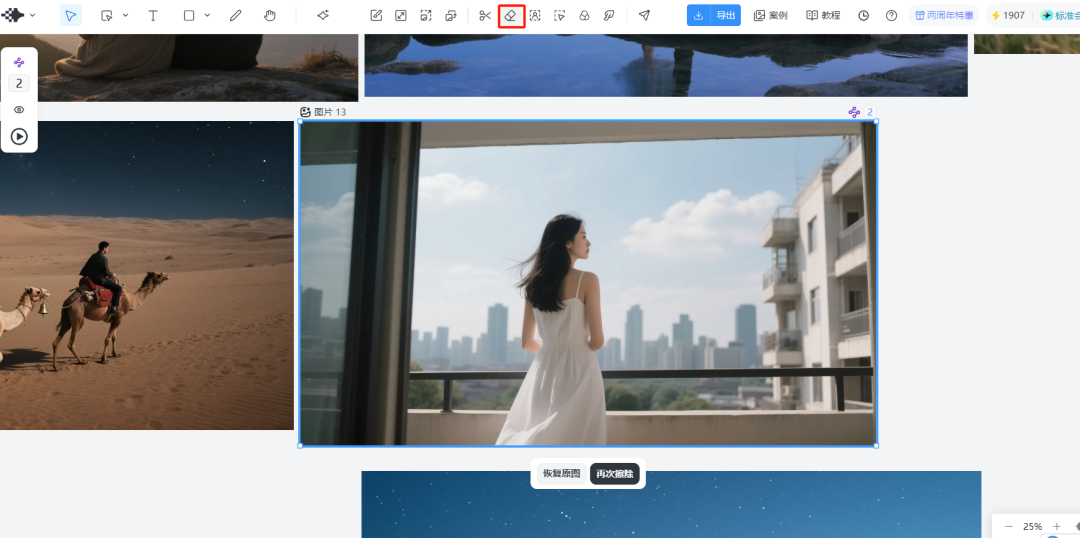

分镜图出来之后,用星流去水印,如果想要画面质感更好,最好是高清处理一下,我为了节省时间只是简单做了水印处理。星流的界面图片是可以随便拉放位置的

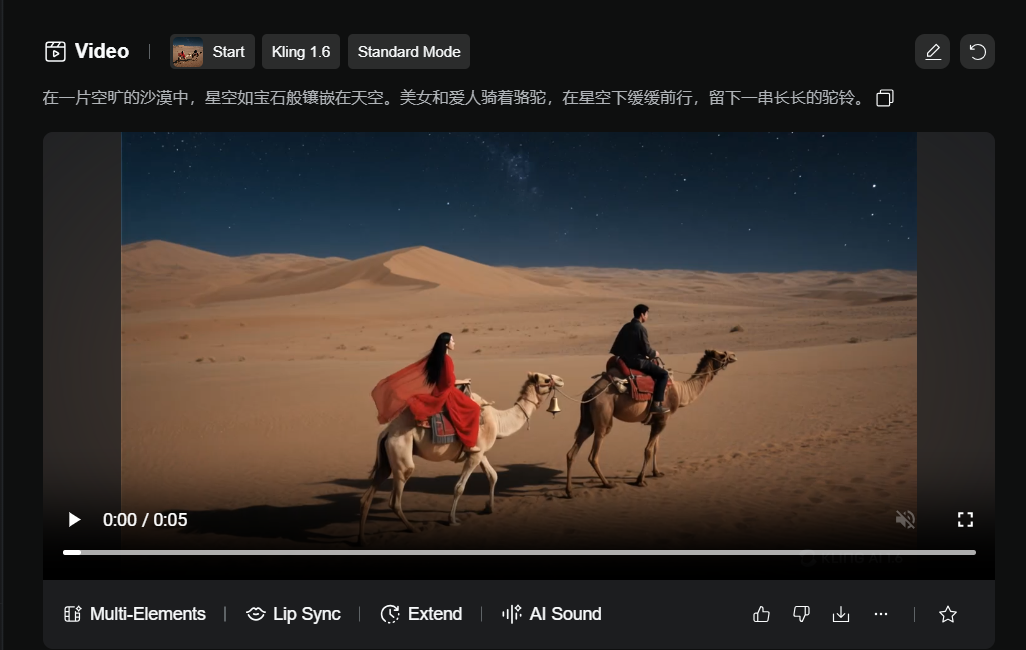

接着我用“即梦”和“可灵”图生视频 即梦3.0真的是不得不夸,出来的视频很多都能一次过。特别是下雨的那几帧看着就很有感觉 即梦3.0真的是很好的理解了情绪,特别是一些眼神的传递,以前的AI眼神很多出来的都是空洞无神,一看就是AI人的感觉

还有可灵生成了一部分视频,我用的国际版

最后剪辑:剪映一键成片 最后一步,是把歌词、旋律、画面剪成完整MV。 操作流程很简单: 新建项目,导入Suno生成的音频; 导入即梦和可灵出的画面(按分镜脚本排序); 剪映填入文本,根据画面,音乐逐步调整画面与歌词 最后导出成品。

可能你们没想到的是,相比于出图,出视频,剪辑才是花了我最多时间的。 当我把成品发出来的时候,很多朋友说你这个视频这么多场景,人物一致性竟然保持的不错。也很有感觉 还有朋友问我这首MV花了多少成本?我说成本是我这个人,哈哈~大家也可以猜一猜~

很多人以为AI创作是“没有灵魂”的,但我想说——AI只是工具,情绪是你的。 ❤️ 最后的话 也许你曾觉得自己不是“创作者”, 但AI时代,创作的门槛还是创意,审美,思维。 当你有感觉、你有话想说—— AI让我们这些普通人,也配拥有自己的MV,也配被世界听见。

|